训练误差和泛化误差

训练误差(training error)指模型在训练数据集上表现出的误差,泛化误差(generalization error)指模型在任意一个测试数据样本上表现出的误差的期望,并常常通过测试数据集上的误差来近似。计算训练误差和泛化误差可以使用损失函数,例如线性回归用到的平方损失函数和softmax回归用到的交叉熵损失函数。

在机器学习里,通常假设训练数据集和测试数据集里的每一个样本都是从同一个概率分布中相互独立地生成的。由训练数据集学到的模型参数会使模型在训练数据集上的表现优于或等于在测试数据集上的表现。由于无法从训练误差估计泛化误差,一味地降低训练误差并不意味着泛化误差一定会降低。

机器学习模型应关注降低泛化误差。

模型选择

在机器学习中,通常需要评估若干候选模型的表现并从中选择模型。这一过程称为模型选择(model selection)。可供选择的候选模型可以是有着不同超参数的同类模型。以多层感知机为例,可以选择隐藏层的个数,以及每个隐藏层中隐藏单元个数和激活函数。

验证数据集

从严格意义上讲,测试集只能在所有超参数和模型参数选定后使用一次。不可以使用测试数据选择模型,如调参。由于无法从训练误差估计泛化误差,因此也不应只依赖训练数据选择模型。鉴于此,可以预留一部分在训练数据集和测试数据集以外的数据来进行模型选择。这部分数据被称为验证数据集,简称验证集(validation set)。例如,可以从给定的训练集中随机选取一小部分作为验证集,而将剩余部分作为真正的训练集。

然而在实际应用中,由于数据不容易获取,测试数据极少只使用一次就丢弃。因此,实践中验证数据集和测试数据集的界限可能比较模糊。

$K$折交叉验证

由于验证数据集不参与模型训练,当训练数据不够用时,预留大量的验证数据显得太奢侈。一种改善的方法是$K$折交叉验证($K$-fold cross-validation)。在$K$折交叉验证中,把原始训练数据集分割成$K$个不重合的子数据集,然后做$K$次模型训练和验证。每一次,使用一个子数据集验证模型,并使用其他$K-1$个子数据集来训练模型。在这$K$次训练和验证中,每次用来验证模型的子数据集都不同。最后,对这$K$次训练误差和验证误差分别求平均。

欠拟合和过拟合

欠拟合(underfitting):模型无法得到较低的训练误差;过拟合(overfitting):模型的训练误差远小于它在测试数据集上的误差。模型复杂度和训练数据集大小是影响这两种拟合的重要因素。

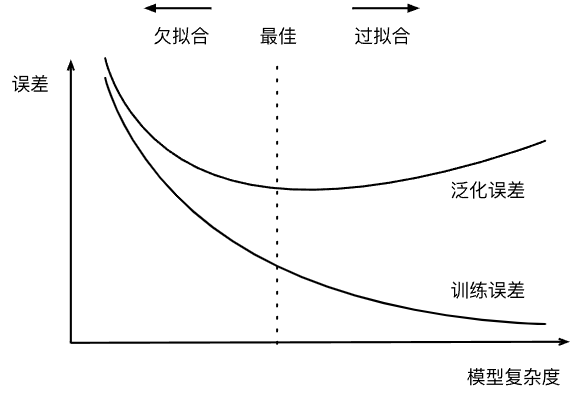

模型复杂度

以多项式函数拟合为例。给定一个由标量数据特征$x$和对应的标量标签$y$组成的训练数据集,多项式函数拟合的目标是找一个$K$阶多项式函数

$$

\hat{y} = b + \sum_{k=1}^K x^k w_k

$$

来近似 $y$。在上式中,$w_k$是模型的权重参数,$b$是偏差参数。与线性回归相同,多项式函数拟合也使用平方损失函数。特别地,一阶多项式函数拟合又叫线性函数拟合。

因为高阶多项式函数模型参数更多,模型函数的选择空间更大,所以高阶多项式函数比低阶多项式函数的复杂度更高。因此,高阶多项式函数比低阶多项式函数更容易在相同的训练数据集上得到更低的训练误差。给定训练数据集,模型复杂度和误差之间的关系通常如下图所示。给定训练数据集,如果模型的复杂度过低,很容易出现欠拟合;如果模型复杂度过高,很容易出现过拟合。应对欠拟合和过拟合的一个办法是针对数据集选择合适复杂度的模型。

训练数据集大小

影响欠拟合和过拟合的另一个重要因素是训练数据集的大小。如果训练数据集中样本数过少,特别是比模型参数数量(按元素计)更少时,过拟合更容易发生。此外,泛化误差不会随训练数据集里样本数量增加而增大。通常希望训练数据集大一些,特别是在模型复杂度较高时,例如层数较多的深度学习模型。

多项式函数拟合实验

以多项式函数拟合为例来实验。导入需要的库。

import torch

import numpy as np

import matplotlib.pyplot as plt

from IPython import display生成数据集

生成一个人工数据集。在训练数据集和测试数据集中,给定样本特征$x$,使用如下的三阶多项式函数来生成该样本的标签:

$$

y = 1.2x – 3.4x^2 + 5.6x^3 + 5 + \epsilon,

$$

其中噪声项$\epsilon$服从均值为0、标准差为0.01的正态分布。训练数据集和测试数据集的样本数都设为100。

n_train, n_test, true_w, true_b = 100, 100, [1.2, -3.4, 5.6], 5

features = torch.randn((n_train + n_test, 1)) # 生成随机数据x值,形状为(200,1)

poly_features = torch.cat((features, torch.pow(features, 2), torch.pow(features, 3)), 1) # 计算x的1、2、3次方。torch.cat是将三个张量拼接在一起,形状为(200,3)

labels = (true_w[0] * poly_features[:, 0] + true_w[1] * poly_features[:, 1]

+ true_w[2] * poly_features[:, 2] + true_b) # 计算y值

labels += torch.tensor(np.random.normal(0, 0.01, size=labels.size()), dtype=torch.float) # 加上噪声定义、训练和测试模型

定义绘图函数:

def set_figsize(figsize=(3.5, 2.5)):

display.set_matplotlib_formats('png')

plt.rcParams['figure.figsize'] = figsize

def semilogy(x_vals, y_vals, x_label, y_label, x2_vals=None, y2_vals=None,

legend=None, figsize=(3.5, 2.5)):

set_figsize(figsize)

plt.xlabel(x_label)

plt.ylabel(y_label)

plt.semilogy(x_vals, y_vals) # y轴使用对数尺度

if x2_vals and y2_vals:

plt.semilogy(x2_vals, y2_vals, linestyle=':')

plt.legend(legend)

plt.show()多项式函数拟合也使用平方损失函数。将尝试使用不同复杂度的模型来拟合生成的数据集。定义模型:

num_epochs, loss = 100, torch.nn.MSELoss() # 设置迭代周期数和损失函数

def fit_and_plot(train_features, test_features, train_labels, test_labels):

net = torch.nn.Linear(train_features.shape[-1], 1) # 线性回归模型

# 通过Linear文档可知,pytorch已经将参数初始化了,所以这里就不手动初始化了

batch_size = min(10, train_labels.shape[0]) # 设置批量大小

dataset = torch.utils.data.TensorDataset(train_features, train_labels) # 设置数据集

train_iter = torch.utils.data.DataLoader(dataset, batch_size, shuffle=True) # 设置数据迭代器

train_labels = train_labels.view(-1, 1) # 转换标签形状

test_labels = test_labels.view(-1, 1) # 转换标签形状

optimizer = torch.optim.SGD(net.parameters(), lr=0.01) # 设置优化算法

train_ls, test_ls = [], [] # 训练和测试损失

for _ in range(num_epochs): # 训练模型,迭代周期

for X, y in train_iter: # X是特征,y是标签

l = loss(net(X), y.view(-1, 1)) # 计算损失,y.view(-1, 1)将y的形状转换成和预测值y的形状一样

optimizer.zero_grad() # 梯度清零

l.backward() # 计算梯度

optimizer.step() # 迭代模型参数

train_ls.append(loss(net(train_features), train_labels).item()) # 计算训练损失

test_ls.append(loss(net(test_features), test_labels).item()) # 计算测试损失

print('最终周期:训练损失 ', train_ls[-1], '测试损失 ', test_ls[-1])

print('weight:', net.weight.data,

'\nbias:', net.bias.data)

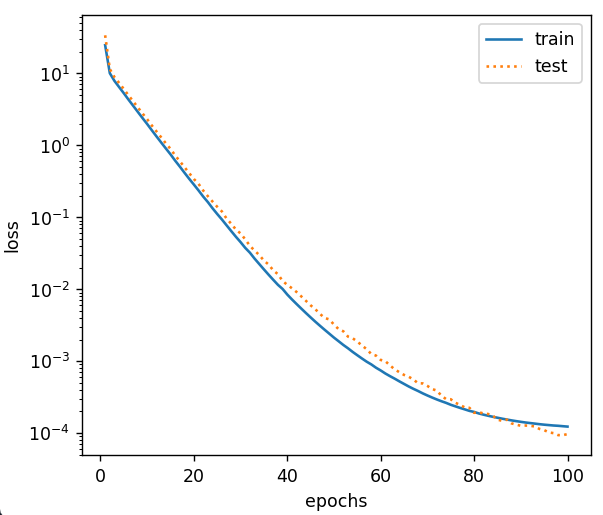

semilogy(range(1, num_epochs + 1), train_ls, 'epochs', 'loss', range(1, num_epochs + 1), test_ls, ['train', 'test'])三阶多项式函数拟合(正常)

先使用与数据生成函数同阶的三阶多项式函数拟合。实验表明,这个模型的训练误差和在测试数据集的误差都较低。训练出的模型参数也接近真实值。

fit_and_plot(poly_features[:n_train, :], poly_features[n_train:, :], labels[:n_train], labels[n_train:]) # 三阶多项式函数,传入3个特征,即x的1、2、3次方,代表三阶多项式函数输出:

最终周期:训练损失 0.00012335127394180745 测试损失 9.706116543384269e-05

weight: tensor([[ 1.2056, -3.4008, 5.5980]])

bias: tensor([5.0013])

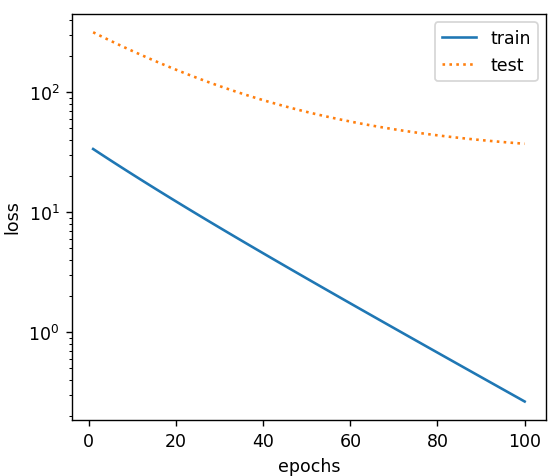

线性函数拟合(欠拟合)

该模型的训练误差在迭代早期下降后便很难继续降低。在完成最后一次迭代周期后,训练误差依旧很高。线性模型在非线性模型(如三阶多项式函数)生成的数据集上容易欠拟合。

fit_and_plot(features[:n_train, :], features[n_train:, :], labels[:n_train], labels[n_train:]) # 线性函数,传入1个特征,即x,代表线性函数输出:

最终周期:训练损失 183.3161163330078 测试损失 314.3257751464844

weight: tensor([[19.3992]])

bias: tensor([4.1038])

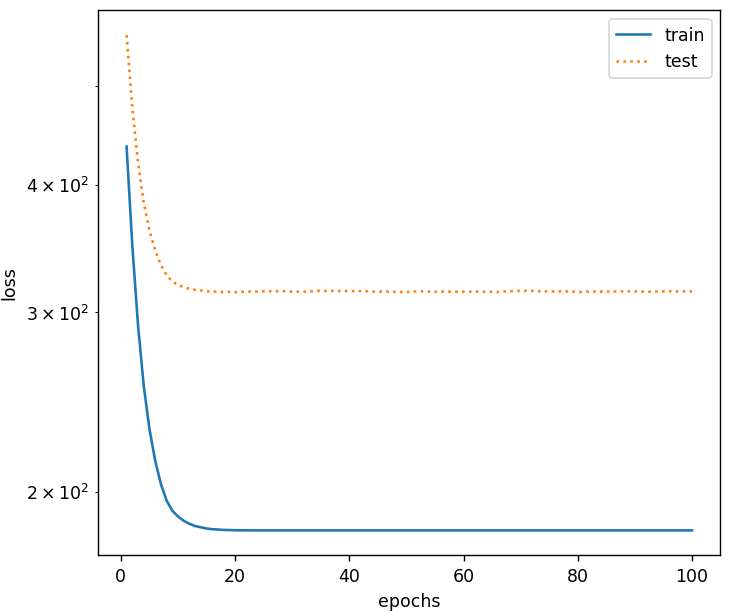

训练样本不足(过拟合)

事实上,即便使用与数据生成模型同阶的三阶多项式函数模型,如果训练样本不足,该模型依然容易过拟合。只使用两个样本来训练模型。显然,训练样本过少了,甚至少于模型参数的数量。这使模型显得过于复杂,以至于容易被训练数据中的噪声影响。在迭代过程中,尽管训练误差较低,但是测试数据集上的误差却很高。这是典型的过拟合现象。

fit_and_plot(poly_features[0:2, :], poly_features[n_train:, :], labels[0:2], labels[n_train:]) # 过拟合输出:

最终周期:训练损失 0.26395294070243835 测试损失 37.11482238769531

weight: tensor([[3.8149, 0.2624, 2.9220]])

bias: tensor([1.2183])